python抓取网页数据(历史消息界面将屏幕向上滑动每次都可以加载10条历史)

优采云 发布时间: 2022-04-05 02:12python抓取网页数据(历史消息界面将屏幕向上滑动每次都可以加载10条历史)

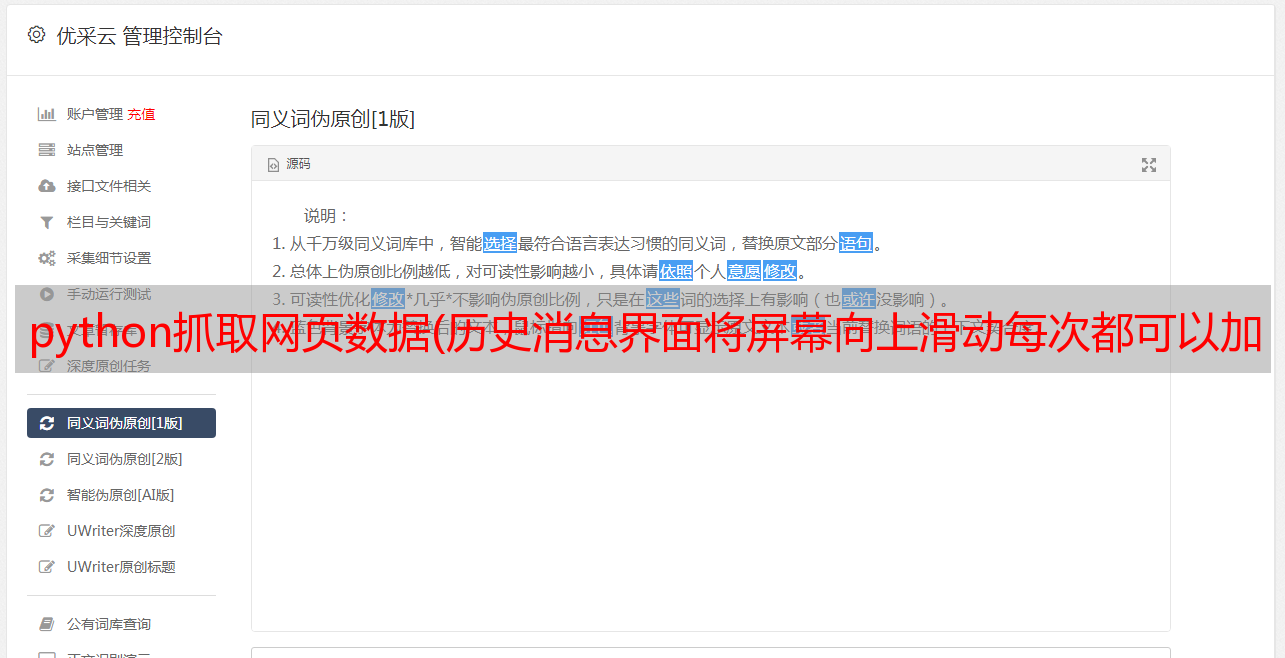

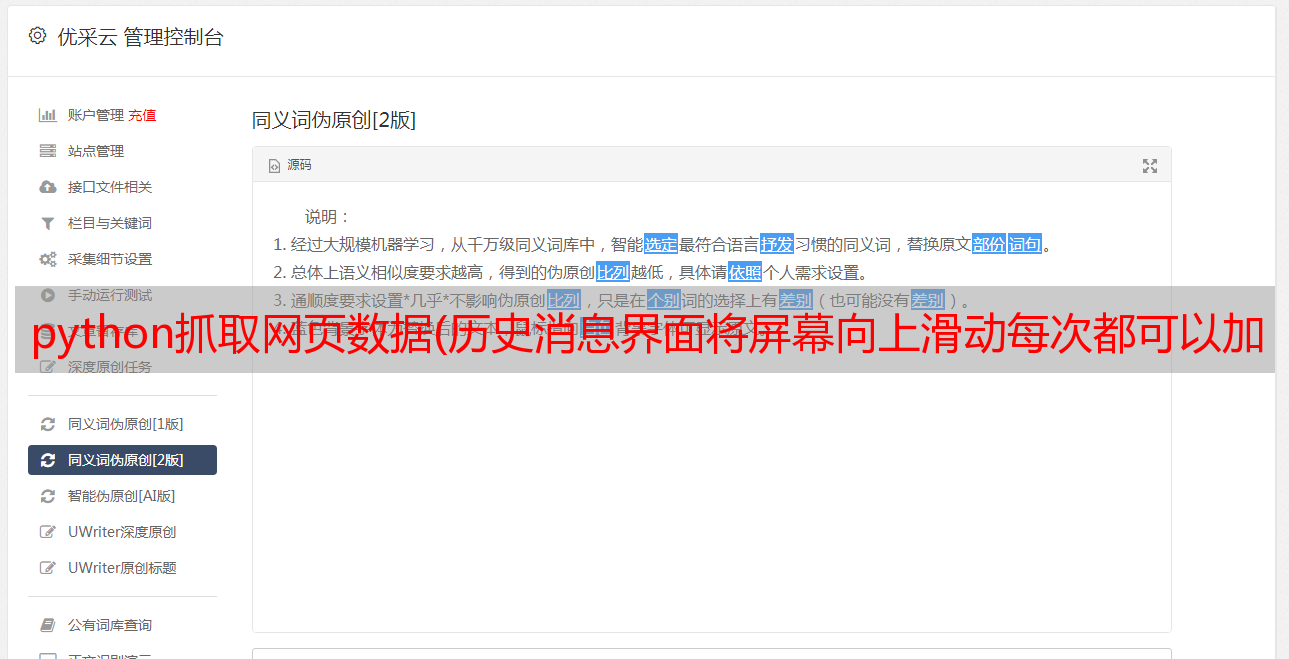

在移动端安装证书并设置好IP代理后,点击一个微信公众号文章(这里使用这个公众号)

从图中可以看出,阅读、重看、点赞的url是./mp/getappmsgext(提示:如果没有这个链接,可以刷新右上角的文章角),然后再看一下request请求需要什么

你只需要一个 文章 url、user-agent、cookie 和 body,四个基本数据。别看下面正文中的 20 或 30 个数据,它们实际上很吓人。只需要其中的7个,即__biz、mid、idx、sn这四个参数是获取公众号文章内容的基石,可以在文章url获取。其他三个参数的数据分别固定is_only_read = 1, is_temp_url = 0, appmsg_type = 9。getappmsgext请求中的appmsg_token是一个时间敏感参数。

分析完链接就可以写代码了

import html

import requests

import utils

from urllib.parse import urlsplit

class Articles(object):

"""文章信息"""

def __init__(self, appmsg_token, cookie):

# 具有时效性

self.appmsg_token = appmsg_token

self.headers = {

"User-Agent": "Mozilla/5.0 AppleWebKit/537.36 (KHTML, like Gecko) Version/4.0Chrome/57.0.2987.132 MQQBrowser/6.2 Mobile",

"Cookie": cookie

}

self.data = {

"is_only_read": "1",

"is_temp_url": "0",

"appmsg_type": "9",

}

def read_like_nums(self, article_url):

"""获取数据"""

appmsgstat = self.get_appmsgext(article_url)["appmsgstat"]

return appmsgstat["read_num"], appmsgstat["old_like_num"], appmsgstat["like_num"]

def get_params(self, article_url):

"""

获取到文章url上的请求参数

:param article_url: 文章 url

:return:

"""

# url转义处理

article_url = html.unescape(article_url)

"""获取文章链接的参数"""

url_params = utils.str_to_dict(urlsplit(article_url).query, "&", "=")

return url_params

def get_appmsgext(self, article_url):

"""

请求阅读数

:param article_url: 文章 url

:return:

"""

url_params = self.get_params(article_url)

appmsgext_url = "https://mp. weixin.qq.com/mp/getappmsgext?appmsg_token={}&x5=0".format(self.appmsg_token)

self.data.update(url_params)

appmsgext_json = requests.post(

appmsgext_url, headers=self.headers, data=self.data).json()

if "appmsgstat" not in appmsgext_json.keys():

raise Exception(appmsgext_json)

return appmsgext_json

if __name__ == '__main__':

info = Articles('1068_XQoMoGGBYG8Tf8k23jfdBr2H_LNekAAlDDUe2aG13TN2fer8xOSMyrLV6s-yWESt8qg5I2fJr1r9n5Y5', 'rewardsn=; wxtokenkey=777; wxuin=1681274216; devicetype=android-29; version=27001037; lang=zh_CN; pass_ticket=H9Osk2CMhrlH34mQ3w2PLv/RAVoiDxweAdyGh/Woa1qwGy2jGATJ6hhg7syTQ9nk; wap_sid2=COjq2KEGEnBPTHRVOHlYV2U4dnRqaWZqRXBqaWl3Xy1saXVWYllIVjAzdlM1VkNDNHgxeWpHOG9pckdkREMwTFEwYmNWMl9FZWtRU3pRRnhDS0pyV1BaZUVMWXN1ZWN0WnZ6aHFXdVBnbVhTY21BYnBSUXNCQUFBMLLAjfgFOA1AAQ==')

a, b,c = info.read_like_nums('http://mp. weixin.qq.com/s?__biz=MzU1NDk2MzQyNg==&mid=2247486254&idx=1&sn=c3a47f4bf72b1ca85c99190597e0c190&chksm=fbdad3a3ccad5ab55f6ef1f4d5b8f97887b4a344c67f9186d5802a209693de582aac6429a91c&scene=27#wechat_redirect')

print(a, b, c)

样本结果

# 阅读数 点赞数 再看数

1561 23 18

动态获取cookies和appmsg_token

appmsg_token 是一个时间敏感的参数,需要像 cookie 一样改变。当这两个参数过期时,需要从抓包工具(MitmProxy)到代码中ctrl+C和ctrl+V,非常麻烦。

MitmProxy 可以使用命令行界面 mitmdumvp 运行 Python 代码来监控抓取的链接。如果 /mp/getappmsgext 被捕获,它将被保存在本地文件中并退出捕获

mitmdump 命令

# -s 运行的python脚本, -w 将截取的内容保持到文件

mitmdump -s write_cookie.py -w outfile mp.weixin.qq.com/mp/getappmsgext

监控脚本

import urllib

import sys

from mitmproxy import http

# command: mitmdump -s write_cookie.py -w outfile mp.weixin.qq.com/mp/getappmsgext

class WriterCookie:

"""

mitmproxy的*敏*感*词*脚本,写入cookie和url到文件

"""

def __init__(self, outfile: str) -> None:

self.f = open(outfile, "w")

def response(self, flow: http.HTTPFlow) -> None:

"""

完整的response响应

:param flow: flow实例,

"""

# 获取url

url = urllib.parse.unquote(flow.request.url)

# 将url和cookie写入文件

if "mp. weixin.qq.com/mp/getappmsgext" in url:

self.f.write(url + '\n')

self.f.write(str(flow.request.cookies))

self.f.close()

# 退出

exit()

# 第四个命令中的参数

addons = [WriterCookie(sys.argv[4])]

监控脚本写好后,编写启动命令和解析url和cookie文件的模块

import re

import os

class ReadCookie(object):

"""

启动write_cookie.py 和 解析cookie文件,

"""

def __init__(self, outfile):

self.outfile = outfile

def parse_cookie(self):

"""

解析cookie

:return: appmsg_token, biz, cookie_str·

"""

f = open(self.outfile)

lines = f.readlines()

appmsg_token_string = re.findall("appmsg_token.+?&", lines[0])

biz_string = re.findall('__biz.+?&', lines[0])

appmsg_token = appmsg_token_string[0].split("=")[1][:-1]

biz = biz_string[0].split("__biz=")[1][:-1]

cookie_str = '; '.join(lines[1][15:-2].split('], [')).replace('\'','').replace(', ', '=')

return appmsg_token, biz, cookie_str

def write_cookie(self):

"""

启动 write_cookie。py

:return:

"""

#当前文件路径

path = os.path.split(os.path.realpath(__file__))[0]

# mitmdump -s 执行脚本 -w 保存到文件 本命令

command = "mitmdump -s {}/write_cookie.py -w {} mp.weixin.qq.com/mp/getappmsgext".format(

path, self.outfile)

os.system(command)

if __name__ == '__main__':

rc = ReadCookie('cookie.txt')

rc.write_cookie()

appmsg_token, biz, cookie_str = rc.parse_cookie()

print("appmsg_token:" + appmsg_token , "\nbiz:" + biz, "\ncookie:"+cookie_str)

样本结果

解析cookie.txt文件内容后

appmsg_token:1068_av3JWyDn2XCS2fwFj3ICCnwArRb2kU4Y5Y5m9Z9NkWoCOszl3a-YHFfBkAguUlYQJi2dWo83AQT4FsNK

biz:MzU1NDk2MzQyNg==

cookie:rewardsn=; wxtokenkey=777; wxuin=1681274216; devicetype=android-29; version=27001037; lang=zh_CN; pass_ticket=H9Osk2CMhrlH34mQ3w2PLv/RAVoiDxweAdyGh/Woa1qwGy2jGATJ6hhg7syTQ9nk; wap_sid2=COjq2KEGEnBPTHRVOHlYV2U4dnRqaWZqRXBqaWktTHpUSEJnTTdhU0hVZTEtZXpZZEY4a3lNY29zc0VZeEFvLS01YmJRRnQ5eFRmR2dOY29nUWdKSTRVWG13WE1obGs1blhQcVh0V18tRnBSRnVlc1VhOHNCQUFBMPeIjfgFOA1AAQ==

ReadCookie模块可以自动获取appmsg_token和cookies,作为参数传递给Articles模块,这样就可以解放双手,永远不用复制粘贴appmsg_token和cookies,只需要在appmsg_token过期时刷新公众号文章就是这样它,省心省时间

批量提取

在公众号历史消息界面向上滑动屏幕,每次可加载10条历史消息。盲目猜测,这个翻页就是批量抓取的请求链接。使用MitmProxy的WEBUI界面在Response面板中找到,找到一个为/mp /profile_ext?action=getmsg&__biz=MzU1NDk2MzQyNg==&f=json&offset=10&count=10…的链接,其response返回值有多个文章 headers,然后看这个链接有offset=10&count=10参数,一看就是页面偏移量和每页显示的bar条数,就这样

链接中比较重要的参数有:__biz、offset、pass_ticket、appmsg_token,这些数据可以在cookie和appmsg_token中获取。

# utils.py

# 工具模块,将字符串变成字典

def str_to_dict(s, join_symbol="\n", split_symbol=":"):

s_list = s.split(join_symbol)

data = dict()

for item in s_list:

item = item.strip()

if item:

k, v = item.split(split_symbol, 1)

data[k] = v.strip()

return data

import os

import requests

import json

import urllib3

import utils

class WxCrawler(object):

"""翻页内容抓取"""

urllib3.disable_warnings()

def __init__(self, appmsg_token, biz, cookie, begin_page_index = 0, end_page_index = 100):

# 起始页数

self.begin_page_index = begin_page_index

# 结束页数

self.end_page_index = end_page_index

# 抓了多少条了

self.num = 1

self.appmsg_token = appmsg_token

self.biz = biz

self.headers = {

"User-Agent": "Mozilla/5.0 AppleWebKit/537.36 (KHTML, like Gecko) Version/4.0Chrome/57.0.2987.132 MQQBrowser/6.2 Mobile",

"Cookie": cookie

}

self.cookie = cookie

def article_list(self, context):

articles = json.loads(context).get('general_msg_list')

return json.loads(articles)

def run(self):

# 翻页地址

page_url = "https://mp. weixin.qq.com/mp/profile_ext?action=getmsg&__biz={}&f=json&offset={}&count=10&is_ok=1&scene=&uin=777&key=777&pass_ticket={}&wxtoken=&appmsg_token=" + self.appmsg_token + "&x5=0f=json"

# 将 cookie 字典化

wx_dict = utils.str_to_dict(self.cookie, join_symbol='; ', split_symbol='=')

# 请求地址

response = requests.get(page_url.format(self.biz, self.begin_page_index * 10, wx_dict['pass_ticket']), headers=self.headers, verify=False)

# 将文章列表字典化

articles = self.article_list(response.text)

for a in articles['list']:

# 公众号中主条

if 'app_msg_ext_info' in a.keys() and '' != a.get('app_msg_ext_info').get('content_url', ''):

print(str(self.num) + "条", a.get('app_msg_ext_info').get('title'), a.get('app_msg_ext_info').get('content_url'))

# 公众号中副条

if 'app_msg_ext_info' in a.keys():

for m in a.get('app_msg_ext_info').get('multi_app_msg_item_list', []):

print(str(self.num) + "条", m.get('title'), a.get('content_url'))

self.num = self.num + 1

self.is_exit_or_continue()

# 递归调用

self.run()

def is_exit_or_continue(self):

self.begin_page_index = self.begin_page_index + 1

if self.begin_page_index > self.end_page_index:

os.exit()

最后使用自动cookie启动程序并刷新公众号文章

from read_cookie import ReadCookie

from wxCrawler import WxCrawler

"""程序启动类"""ss

if __name__ == '__main__':

cookie = ReadCookie('E:/python/cookie.txt')

cookie.write_cookie()

appmsg_token, biz, cookie_str = cookie.parse_cookie()

wx = WxCrawler(appmsg_token, biz, cookie_str)

wx.run()

样本结果

总结

这篇文章虽然可能有点头条党,但是并没有完全自动抓取数据,需要人为刷新公众号文章。希望大家不要介意。