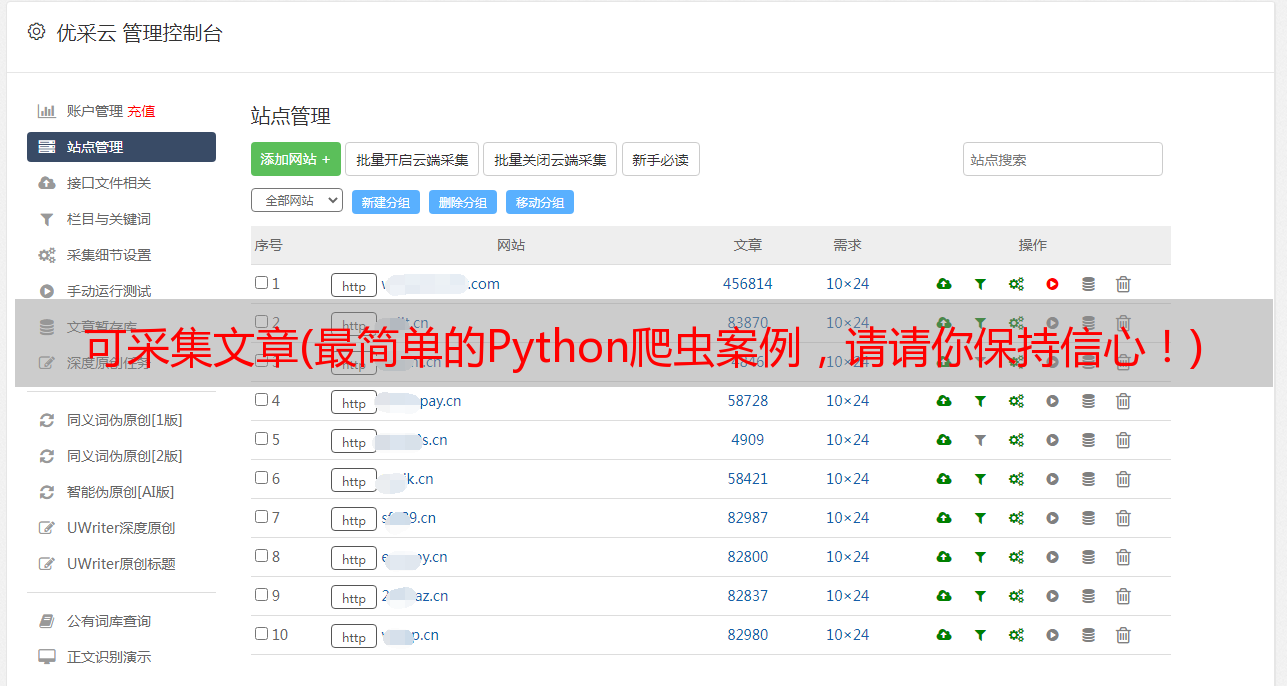

可采集文章(最简单的Python爬虫案例,请请你保持信心!)

优采云 发布时间: 2021-10-12 10:21可采集文章(最简单的Python爬虫案例,请请你保持信心!)

这是最简单的Python爬虫案例。如果你能看懂,请保持信心,因为你已经开始使用Python爬虫了。只要你有信心,努力工作,你的技术能力将来值15K月薪。

这次想爬取网易新闻,包括新闻标题、作者、来源、发布时间、正文等。

第一步,我们先找到网易新闻的网站,打开,选择其中一个分类,比如:国内新闻,然后点击鼠标右键查看源码。最后,如果你的时间不是很紧,想快速提高,最重要的是你不怕吃苦。我建议你可以定价@762459510。那真的很好。很多人都在快速进步。你需要害怕困难!可以去加进去看看~

3、确定学习方向

如果您遇到以下情况:

源码中页面中间没有新闻列表。这说明这个页面是异步的。即通过api接口获取的数据。

确认后使用F12打开谷歌浏览器的控制台,点击网络。我们一直往下滚动,发现右侧出现了:“... special/00804KVA/cm_guonei_03.js?...”等地址,点击Opening Response发现就是我们要找的api接口。

可以看到这些接口的地址有一定的规律:“cm_guonei_03.js”、“cm_guonei_04.js”,那么就很明显了:

(*).js

上面的链接是我们这次抓取请求的地址。

接下来只需要两个python库:

requestsjsonBeautifulSoup

requests 库用于发出网络请求。说白了就是模拟浏览器获取资源。由于我们的采集是一个api接口,它的格式是json,所以我们需要使用json库来解析。BeautifulSoup用于解析html文档,可以方便的帮助我们获取指定div的内容。最后,如果你的时间不是很紧,想快速提高,最重要的是你不怕吃苦。我建议你可以定价@762459510。那真的很好。很多人都在快速进步。你需要害怕困难!可以去加进去看看~

3、确定学习方向

下面我们正式进入爬虫程序的编写

第一步是导入以上三个包:

然后我们定义一个方法来获取指定页码中的数据:

这样就得到了每个页码对应的内容列表:

对数据进行分析后,我们可以看到下图圈出了需要爬取的标题、发布时间、新闻内容页面。

既然已经获取到内容页面的url,那么就开始爬取新闻正文。

在抓取文本之前,分析文本的html页面,找到文本、作者、来源在html文档中的位置。

我们看到文章的source在文档中的位置是:id = "ne_article_source"的标签。作者的立场是:span标签,class="ep-editor"。正文位置是:带有 class = "post_text" 的 div 标签。

下面采集这三个内容的代码:

到目前为止,我们要抓取的数据都是采集。

然后,当然,保存它们。为了方便起见,我直接以文本的形式保存它们。这是最终结果:

格式为json字符串,"title": ['date','url','source','author','body']。

需要说明的是,目前的实现方式是完全同步和线性的。问题是 采集 会很慢。主要延迟在网络IO,下次可以升级为异步IO,异步采集,有兴趣的可以关注下文章。最后,如果你的时间不是很紧,想快速提高,最重要的是你不怕吃苦。我建议你可以定价@762459510。那真的很好。很多人都在快速进步。你需要害怕困难!可以去加进去看看~

3、确定学习方向

通过本次练习,您应该对爬虫有了入门级的了解。

一姐Python干货推荐:

有学者表示,这些Python书籍是快速入门的关键,却被忽视了