谷歌搜索引擎优化(2016年谷歌比较看重的几个有利因素以及不利因素因素)

优采云 发布时间: 2021-09-04 17:09谷歌搜索引擎优化(2016年谷歌比较看重的几个有利因素以及不利因素因素)

新的一年又开始了,很多读者跟我说他的网站上不去。问他做了哪些优化,他按照一些书的标题标签收录关键词,H1标签收录关键词,网站中的锚文本或标签等,基础书他做了什么他说,他没有效果也是情有可原的。因为这些都是很多年前别人总结出来的因素,那些年确实有用,但是现在很多SEO因素在排名上都降低了。既然要排名,那么首先要了解谷歌目前更看重哪些点。在这里,daniel 总结了 Google 在 2016 年看重的几个有利和不利因素。

影响谷歌搜索引擎排名的有利因素

TR,也叫TrustRank,指的是网站的权威。这意味着您的网站 是否收到了来自受信任的网站 的链接;

DA,又称Dmoain Age,域名年龄,又称域名权重,域名越长,排名越好;

PR,Page Rank,虽然他对排名的影响从70%下降到40%,但仍然是影响排名的主要因素;

更新频率(update frequecy),指的是你网站update原创内容的频率;

LSI(Latent Semantic Indexing),网页是否添加了潜在语义索引词来替换部分target关键词;

社交媒体,即 Facebook、Twitter、Pinteret 在您的网页上的表现数据。 (你页面的点赞和转发量,以及转发你的文章的用户的权限等)

手机自适应,或者使用谷歌刚刚推出的AMP项目,让你的网站可以更好的显示在手机上,提高加载速度。

这不是 H 标签。在主关键词 上添加 B 标签完全没用。这些优化方式已经从“需求”变成了“标准”,这里不再赘述。多说。

并不是在利用了所有有利因素后排名,因为在优化过程中处理不利因素是不可避免的。在优化过程中,我们还应该注意以下几点对谷歌来说比较重要的不利因素。 :

影响谷歌搜索引擎排名的几个不利因素

页面导出大量不相关链接,或导出到不受信任的网站;

网页生成大量无价值的页面;

反向链接只优化特定词,目的性太强(参考LSI的作用);

关键词在站内出现频率过高,优化过度;

从参加过链接研讨会的站长那里购买链接;

外链形式单一,长期从单一站点获取链接;

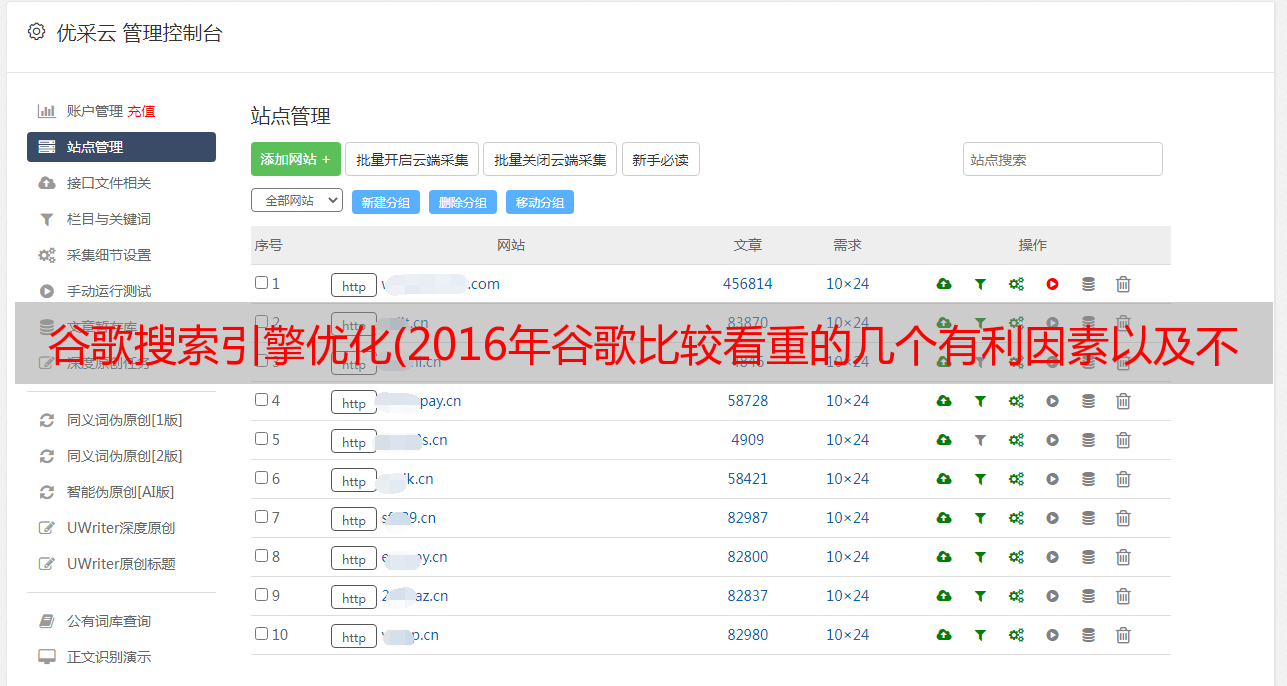

很多人会问,影响网站的不利因素比较多,为什么要关注这些?因为大牛拿优化后的订单时,发现有很多人有这样的问题,而且谷歌响应速度极快。比如:一个冒牌的朋友发了个黑链(用DIV+CSS隐藏锚文本),但是我观察了很久,网站没有降级。相反,当仿牌方法从黑链变成黑页时(在被黑的SHELL中,大量的HTML页面被导入生成大量的反向链接页面),如第二条所述,谷歌站长会立即检测到(时间不会超过7天),并添加人工干预(Manual Action),如图:

加入人工干预的网站,排名会急剧下降,短时间内很难恢复网站的排名,所以这就是第二项被收录的原因在主要因素中。

为了防止网页被大量无价值的页面生成并被谷歌发现,丹尼尔有一个基于Wordpress被黑不被谷歌检测的方法。当然,这也不是一劳永逸的办法,关键是自己做好网站的各种安全保护。

目前很多新手都有一个误区,就是一些SEO论坛说的关键词密度最好达到7%-11%。事实上,事实并非如此。目前谷歌更看重LSI词的比例。

如果同一目标关键词在一个页面上出现5次,而一个页面上只出现2个目标关键词和3个LSI词,后者排名更高;

至于目标关键词密度,我个人认为只要放目标关键词(H1标签,标题)等就好了,没有必要故意叠起来。

如果你还是特别看重关键词密度的话,大牛推荐你使用SEOBOOK关键词密度测量工具,会比国内的工具更准确