网站采集秘籍:数据大揭秘

优采云 发布时间: 2024-02-07 20:42一、什么是网站采集?

网络采集泛指利用自动化工具去搜集和储存互联网信息,以便进一步的处理与应用。这一方式有助于迅速搜集海量数据,为深入研究和深度发掘提供便利。

二、为什么要进行网站采集?

网站采集有多种用途。首先,它能协助企业尽快掌握竞品信息如价格,促销等,以便拟定更精准的市场战略;其次,对于新闻媒体这类组织而言,网站采集有助于把握最新资讯并作出即时报导;最后,对于科研人员,网站采集乃数据解析及学术研究的关键利器。

三、有哪些常见的网站采集工具?

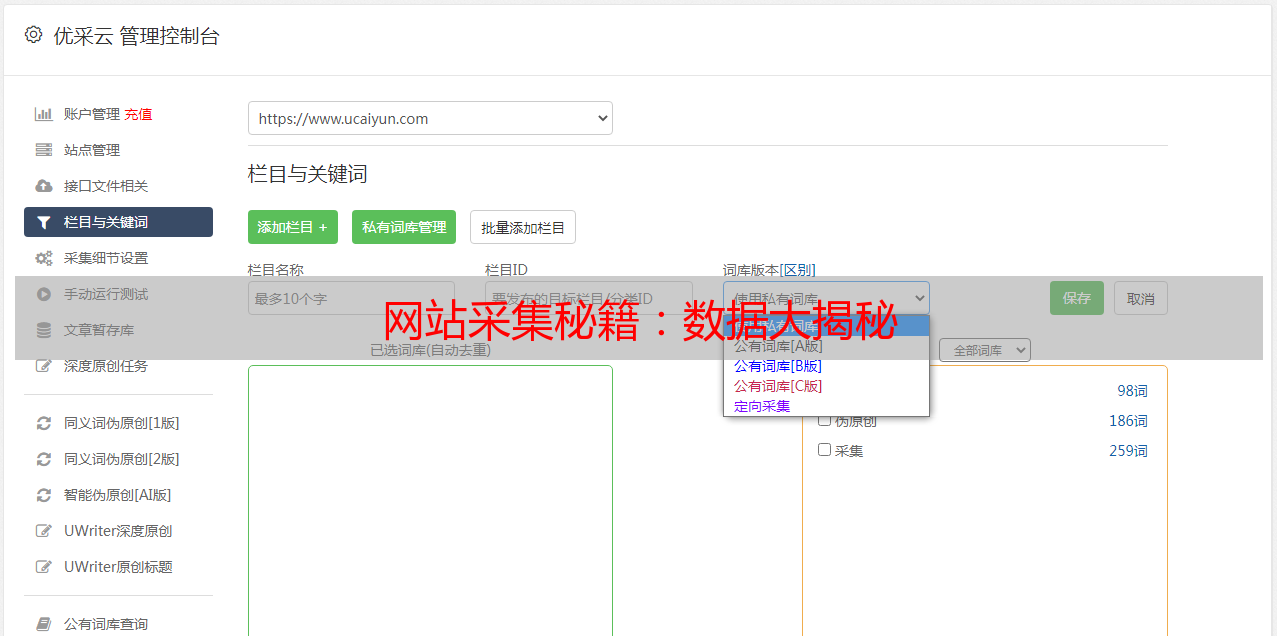

如今市场上已经推出诸多专业的网站采集工具,譬如Scrapy、Beautiful Soup以及Selenium等等。它们都具备广泛且灵活的功能与配置选择,定能满足广大用户各式各样的使用需求。

四、网站采集有哪些注意事项?

在我们进行网站采集操作时,建议大家留意以下这几个方面。首要,务必要遵守目标网站的规定及保护用户隐私,以免给他们带来不必要的麻烦或者损伤到宝贵的用户隐私。第二,请适量设定采集频率,避免过多的动作给目标网站带来不必要的压力。最后但同等重要的是,要确保我们所采集的数据的合法性与准确性,尽可能避免因数据采集错误或不完整而影响到后续分析的结果。

五、如何选择适合自己的网站采集工具?

在选择合适您的网站采集工具时,建议考虑以下几个因素:其一,根据实际需求,选择具备对应功能的工具;其次,依据个人编程水平与经验,选取相应难度的工具;除此之外,还需关注工具的稳定性能及社区提供的支持程度。

六、如何解决网站采集中遇到的问题?

在采集网站信息的过程中,您或许会面临一些困难,如防爬虫设备、动态加载等。请别担心,我们有应对之策。例如,您可以利用代理 IP、模仿浏览器功能等方式来实现困难的突破。更重要的是,当您遇到难题无从下手之际,不妨去查阅相关文档和参与社群讨论,寻找最佳解决之道。

七、如何保证网站采集的效率和质量?

为保证采集效率与质量,以下几种方法值得尝试。首要是控制并发请求与线程,以防过度施压;其次运用缓存技术,防止重复采集无用信息;同时,进行数据清洗和去重处理也有助于提升数据品质。

八、网站采集有哪些法律风险?

尊敬的读者您好,遵循网站采集规定,以合法途径收集并妥善保管数据至关重要,特别是涉及到个人隐私和商业竞争问题时更应如此。在此过程中,请务必遵守相关的法律法规,避免可能出现的法律风险。

九、如何防止自己的网站被他人采集?

如您关心网站被抓取,可采取如下措施保护。首先配置robots.txt文件,缩小搜索引擎及爬虫的访问权限;其次利用验证码或登录确认等形式,防止非法访问;再者,密切关注日志监控,并实施IP锁定阻挡恶意行为。

十、网站采集的未来发展趋势是什么?

悠着点跟着互联网的步伐,我们的网站采摘技术也在持续升级呢!展望未来,网站采摘会越来越智能化,能抵御复杂的反爬虫机制和动态页面。而且,大数据和人工智能也是崭新的热门领域,和网站采摘的结合将为各行各业带来更多有价值的信息哦。

这是关于网站采集的一些常见问题及其答案,愿能帮到您。若有其它疑问,欢迎随时提问哦!