网页数据抓取( Python中正则表达式的3种抓取其中其中数据的方法)

优采云 发布时间: 2022-04-17 16:04网页数据抓取(

Python中正则表达式的3种抓取其中其中数据的方法)

3种方法来抓取其中的数据。首先是正则表达式,然后是流行的 BeautifulSoup 模块,最后是强大的 lxml 模块。

1 正则表达式

如果您是正则表达式的新手,或者需要一些提示,您可以查看它以获得完整的介绍。即使你在其他编程语言中使用过正则表达式,我仍然建议你逐步复习 Python 中正则表达式的编写。

由于可以在每章中构建或使用前几章的内容,因此我建议您遵循类似于本书代码库的文件结构。所有代码都可以从代码库的代码目录运行,以便导入工作正常。如果您希望创建不同的结构,请注意所有来自其他章节的导入都需要更改(例如,来自下面代码中的 chp1.advanced_link_crawler)。

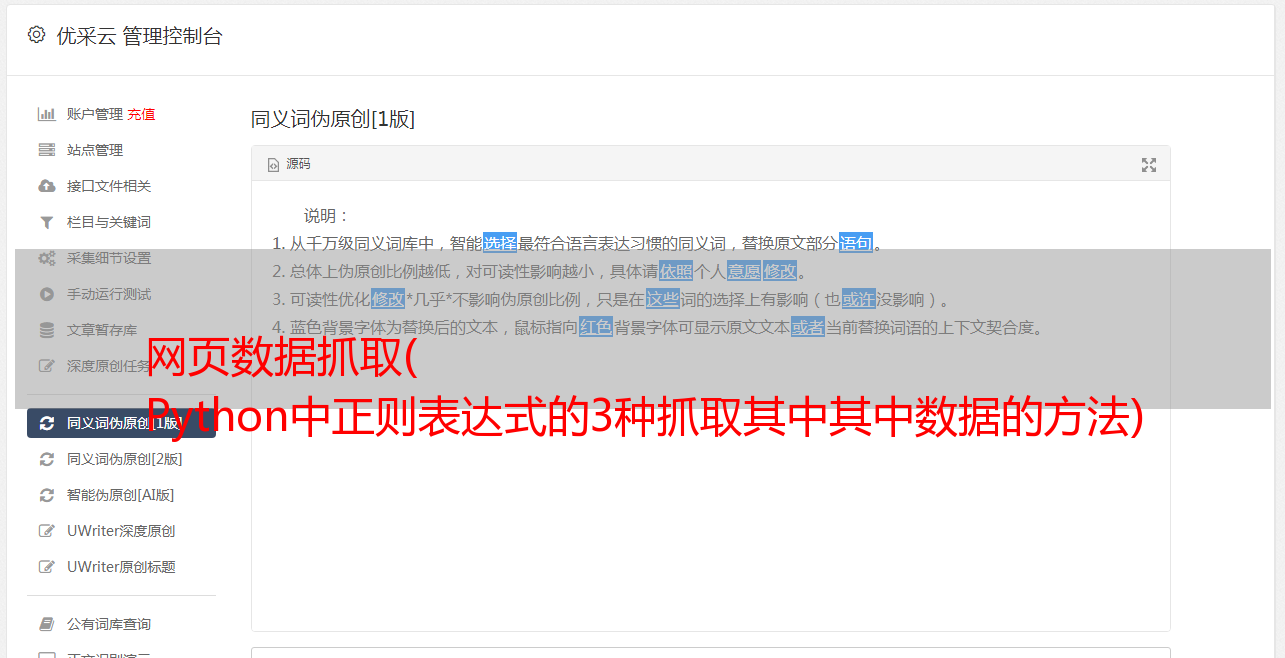

当我们使用正则表达式获取国家(或地区)地区数据时,首先需要尝试匹配`misu中的内容,如下图。

>>> import re>>> from chp1.advanced_link_crawler import download>>> url = 'http://example.python-scraping.com/view/UnitedKingdom-239'>>> html = download(url)>>> re.findall(r'(.*?)', html)['', '244,820 square kilometres', '62,348,447', 'GB', 'United Kingdom', 'London', 'EU', '.uk', 'GBP', 'Pound', '44', '@# #@@|@## #@@|@@# #@@|@@## #@@|@#@ #@@|@@#@ #@@|GIR0AA', '^(([A-Z]d{2}[A-Z]{2})|([A-Z]d{3}[A-Z]{2})|([A-Z]{2}d{2} [A-Z]{2})|([A-Z]{2}d{3}[A-Z]{2})|([A-Z]d[A-Z]d[A-Z]{2}) |([A-Z]{2}d[A-Z]d[A-Z]{2})|(GIR0AA))$', 'en-GB,cy-GB,gd', '

IE

']

从以上结果可以看出,``标签用于多个国家(或地区)属性。如果我们只想抓取国家(或地区)区域,我们可以选择第二个匹配的misu,如下图。

>>> re.findall('(.*?)', html)[1]'244,820 square kilometres'

虽然这个方案现在可用,但如果页面发生变化,它很可能会失败。例如,表已更改为删除第二次匹配中的区域数据。如果我们只抓取当前的数据,我们可以忽略这种未来可能发生的变化。但是,如果我们希望将来能够再次获取这些数据,我们需要提出一个更强大的解决方案,尽可能避免这种布局更改的影响。为了使正则表达式更加明确,我们可以添加它的父元素 `. 由于此元素具有 ID 属性,因此它应该是唯一的。

>>> re.findall('Area: (.*?)', html)['244,820 square kilometres']

这个迭代版本看起来好一点,但是网页更新还有很多其他的方式也会让这个正则表达式不令人满意。例如,将双引号更改为单引号,在`labels 之间添加额外的空格,或更改 area_label` 等。下面是一个改进版本,试图支持这些可能性。

>>> re.findall('''.*?(.*?)''', html)['244,820 square kilometres']

虽然这个正则表达式更容易适应未来的变化,但它也存在构造困难、可读性差的问题。此外,还有许多其他细微的布局更改可能会使此正则表达式无法令人满意,例如为`标签添加标题属性,或修改其CSS类或ID的tr、td`元素。

从这个例子可以看出,正则表达式为我们提供了一种抓取数据的捷径,但是这种方法过于脆弱,在页面更新后容易出现问题。幸运的是,有更好的数据提取解决方案,例如我们将在本章中介绍的其他抓取库。

2美汤

美丽的汤

是一个非常流行的 Python 库,它解析网页并提供方便的界面来定位内容。如果您尚未安装该模块,您可以使用以下命令安装其最新版本。

pip install beautifulsoup4

使用 Beautiful Soup 的第一步是将下载的 HTML 内容解析成一个汤文档。因为很多网页没有很好的 HTML 格式,Beautiful Soup 需要修复其标签的打开和关闭状态。例如,在下面这个简单网页的清单中,存在属性值和未闭合标签周围缺少引号的问题。

如果将 Population 列表项解析为 Area 列表项的子元素,而不是并排的两个列表项,我们会在获取时得到错误的结果。让我们看看Beautiful Soup是如何处理它的。

>>> from bs4 import BeautifulSoup>>> from pprint import pprint>>> broken_html = '

'>>> # 解析 HTML>>> soup = BeautifulSoup(broken_html, 'html.parser')>>> fixed_html = soup.prettify()>>> pprint(fixed_html)

我们可以看到,使用默认的 html.parser 并不能得到正确解析的 HTML。从前面的代码片段可以看出,由于它使用嵌套的 limpids,因此可能会导致定位困难。幸运的是,我们还有其他解析器可供选择。我们可以安装LXML(详见2.2.3),或者使用html5lib。要安装 html5lib,只需使用 pip。

pip install html5lib

现在,我们可以重复此代码,只需对解析器进行以下更改。

>>> soup = BeautifulSoup(broken_html, 'html5lib')>>> fixed_html = soup.prettify()>>> pprint(fixed_html)

至此,使用html5lib的BeautifulSoup已经能够正确解析缺少的属性引号和结束标记,并且还添加了和标记,使其成为一个完整的HTML文档。使用 lxml 时也可以看到类似的结果。

现在,我们可以使用 find() 和 find_all() 方法来定位我们需要的元素。

>>> ul = soup.find('ul', attrs={'class':'country_or_district'})>>> ul.find('li') # returns just the first match

区域

>>> ul.find_all('li') # 返回所有匹配项[Area, Population

有关可用方法和参数的完整列表,请访问 Beautiful Soup 的官方文档。

下面是示例网站中使用该方法提取国家(或地区)区域数据的完整代码。

>>> from bs4 import BeautifulSoup>>> url = 'http://example.python-scraping.com/places/view/United-Kingdom-239'>>> html = download(url)>>> soup = BeautifulSoup(html)>>> # locate the area row>>> tr = soup.find(attrs={'id':'places_area__row'})>>> td = tr.find(attrs={'class':'w2p_fw'}) # locate the data element>>> area = td.text # extract the text from the data element>>> print(area)244,820 square kilometres

此代码虽然比正则表达式代码更复杂,但更易于构建和理解。此外,布局的小变化,如额外的空白和制表符属性,我们不必再担心了。我们也知道 Beautiful Soup 可以帮助我们清理页面,即使它收录不完整的 HTML,允许我们从非常不完整的 网站 代码中提取数据。

3Lxml

lxml

它是基于 XML 解析库 libxml2 构建的 Python 库。它是用C语言编写的,解析速度比Beautiful Soup快,但安装过程也比较复杂,尤其是在Windows下。最新的安装说明可供参考。如果你自己安装库有困难,你也可以使用 Anaconda 来安装。

您可能不熟悉 Anaconda,它是一个员工创建的包和环境管理器,主要专注于开源数据科学包。您可以按照安装说明下载并安装 Anaconda。请务必注意,使用 Anaconda 的快速安装会将您的 PYTHON_PATH 设置为 Conda 的 Python 安装位置。

与 Beautiful Soup 一样,使用 lxml 模块的第一步是将可能无效的 HTML 解析为统一格式。下面是使用此模块解析相同的不完整 HTML 的示例。

>>> from lxml.html import fromstring, tostring>>> broken_html = '

'>>> tree = fromstring(broken_html) # 解析 HTML>>> fixed_html = tostring(tree, pretty_print=True)>>> print(fixed_html)

同样,lxml 正确解析属性周围缺少的引号并关闭标签,但模块不会添加和标签。这些都不是标准 XML 的要求,因此 lxml 没有必要插入它们。

解析输入内容后,进入选择misu的步骤。此时,lxml 有几种不同的方法,例如 XPath 选择器和类似于 Beautiful Soup 的 find() 方法。然而,对于这个例子,我们将使用 CSS 选择器,因为它们更简洁,并且可以在第 5 章解析动态内容时重用。一些读者可能已经从他们使用 jQuery 选择器的经验或它们在前面的使用中熟悉了它们——结束 Web 应用程序开发。在本章后面,我们将比较这些选择器与 XPath 的性能。要使用 CSS 选择器,您可能需要先安装 cssselect 库,如下所示。

pip install cssselect

现在,我们可以使用 lxml 的 CSS 选择器从示例页面中提取区域数据。

>>> tree = fromstring(html)>>> td = tree.cssselect('tr#places_area__row > td.w2p_fw')[0]>>> area = td.text_content()>>> print(area)244,820 square kilometres

通过在代码树上使用cssselect方法,我们可以使用CSS语法选择表中ID为places_area__row的行元素,然后是w2p_fw类的子表数据标签。由于 cssselect 返回一个列表,我们需要获取其中的第一个结果并调用 text_content 方法遍历所有子元素并返回每个元素的关联文本。在这种情况下,即使我们只有一个 mime,此功能对于更复杂的提取示例也很有用。