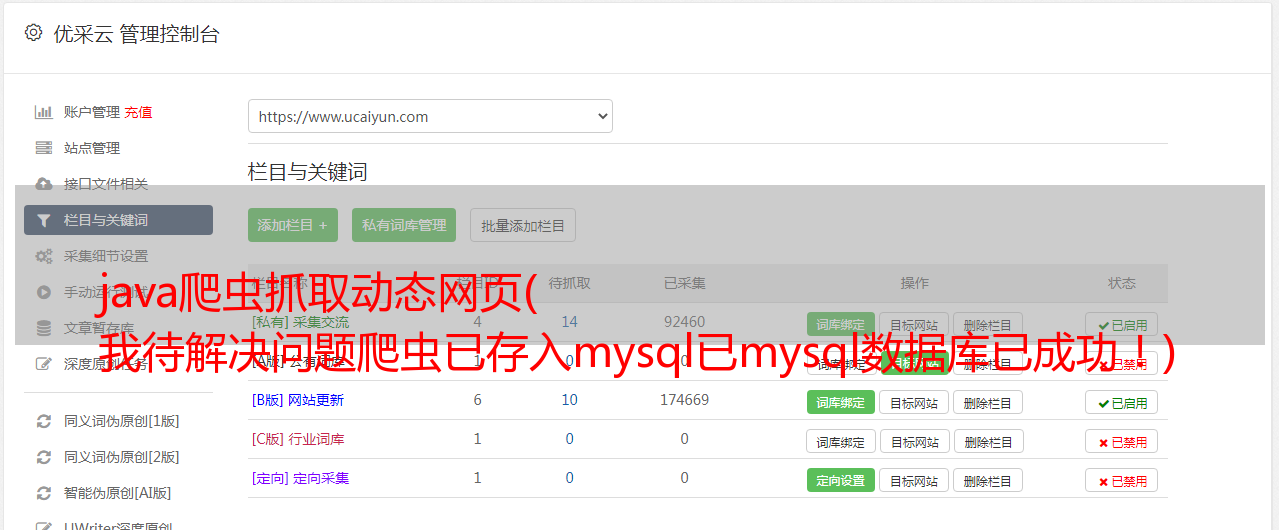

java爬虫抓取动态网页( 我待解决问题爬虫已存入mysql已mysql数据库已成功!)

优采云 发布时间: 2022-04-02 22:03java爬虫抓取动态网页(

我待解决问题爬虫已存入mysql已mysql数据库已成功!)

图片来自简书App

本文文章使用requests和beautifulsoup进行分析;如果您正在寻找正则表达式和 urllib 案例,建议您学习其他材料。

ps:如果要找案例,可以直接看最后一段代码。如果你和我一样,启动爬虫,从文章开始读罗。

前言:自学爬虫第15天,终于成功爬取了58同城的招聘信息,并保存到mysql数据库中……写下这篇文章,分享给正在自学的各位履带式。数据不全:因为有些网页隐藏了一些信息,爬取到的pos_base_browser和pos_base_apply数据都是空的。这个问题仍在解决中。

启示:学习期间我的心态也不稳定,会有逃避的冲动,但让自己坚持下去的动力是一个接一个地解决问题,升级知识体系。重复找资料、百度、百度翻译的过程15天;我最怕看到代码报错;最常见的错误之一是**超出范围。虽然没有人花很多时间找资料,但在不断的探索中,我也得到了解决问题的办法:少问多想——翻译——百度。

文章 分为四个部分:

一、我的爬虫学习目标

二、爬虫学习升级流程:入门10分

三、学习过程中的坑

四、58城市月嫂招聘信息码

五、我有一个问题要解决

爬虫已经存入mysql数据库

一、我的爬虫学习目标

1、了解html、css、javascript

2、master 请求,beautifulsoup 库

3、 会模仿爬虫案例

二、爬虫学习升级流程:入门10分

1、了解html、css、标签

2、学习requests和beautifulsoup库;会获取请求,通过标签选择对应的文本,通过标签选择属性

3、了解静态加载(翻页请求)、动态加载(Ajax)

4、理解函数循环

5、理解 def main(): 函数,name = "main()": 函数

6、了解打印和返回的区别

7、了解索引页(列表页)、详情页、解析详情页url时索引页返回的字典(用于循环)

8、对于数据库的存储,需要在mysql数据库中创建数据库和字段类型。有关详细信息,请参阅代码的第二部分。

9、推荐使用pycharm

10、半自主解决学习过程中出现的任何问题

三、学习过程中的坑:

知道自己会遇到什么问题和问题的类型,即使学习中有问题,也可以通过百度解决。

学习期间,因为不知道怎么提问(因为听不懂,连提问都不会),走了不少弯路。

eg1:解析索引页的时候,不知道应该返回字典的结果格式,折腾了整整两天,突然发现字典可以遍历,把url存成字典可以请求详细信息页面。

eg2:群主一直建议我把爬取的文件保存到数据库,我也看了相关的视频。在不断删除和定义pymysql函数的过程中,我勇敢地尝试解决错误,终于知道了mysql中新数据库、新表、新表中的字段。

自己做不了的时候就去模仿,模仿的过程有问题的时候去百度。

eg3:requests请求没有找到,beautifulsoup解析静态加载案例。拼凑很多视频,代码

……回想起来,中间有很多困惑,但这毕竟是路,只有亲身经历,才能获得成长。希望这个文章能在你切换到数据分析爬虫时对你有所帮助。

四、58城市月嫂招聘信息码

1、目标网点:

坐月子

2、爬取信息:

索引页公司名称;详情页职位名称、更新时间、浏览人数、应聘人数、工资

列表

详情页面

(PS:其实我也想知道索引页的推广方式和发布地址。学习了15天,还是不知道怎么同时保存索引页和详情页的多个内容时间)

3、爬虫代码

《pycharm代码》

import json

import pymysql

import requests

from bs4 import BeautifulSoup

from requests.exceptions import RequestException

headers = {

'user-agent': "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/70.0.3538.102 Safari/537.36"}

def get_one_page(url):

try:

respones = requests.get(url, headers=headers)

respones.encoding = 'utf-8'

if respones.status_code == 200:

return respones.text

return None

except RequestException:

print('请求错误')

return None

def parse_one_page(html):

soup = BeautifulSoup(html, 'lxml')

soup = BeautifulSoup(html, 'lxml')

list_li = soup.find_all('ul', id='list_con')[0].find_all('li', class_='job_item clearfix') # 返回一个列表需要用循环

dir = {}

for link in list_li:

list_a = link.find_all('div', class_='job_name clearfix')[0].find_all('a')[0] # 筛选出所有的a标签

address = list_a.find_all('span', class_='address')[0].text

name = list_a.find_all('span', class_='name')[0].text

comp_name = link.find_all('div', class_='comp_name')[0].find_all('a')[0].text

href = list_a['href']

t = list_a['_t']

dir[href] = comp_name

return dir

def get_two_page(url):

try:

respones = requests.get(url, 'lxml')

if respones.status_code == 200:

return respones.text

return None

except RequestException:

print('请求详情页错误')

return None

def parse_two_page(html,comp_name):

comp_name = comp_name

soup = BeautifulSoup(html, 'lxml')

#pos_base = soup.find_all('div',class_ = 'pos_base_statistics')[0]

pos_name = soup.find_all('span',class_ = 'pos_name')[0].text

pos_base_update = soup.find_all('span', class_='pos_base_num pos_base_update')[0].find_all('span')[0].text # 更新日期

pos_base_browser = soup.find_all('span', class_='pos_base_num pos_base_browser')[0].find_all('i', id='totalcount')[0].text # 浏览量

pos_base_apply = soup.find_all('span', class_='pos_base_num pos_base_apply')[0].find_all('span', id='apply_num')[0].text # 申请数

pos_salary = soup.find_all('div', class_='pos_base_info')[0].find_all('span', class_='pos_salary')[0].text # 工资水平

return comp_name,pos_name, pos_base_update,pos_base_browser, pos_base_apply, pos_salary

def save_to_mysql(comp_name,pos_name, pos_base_update,pos_base_browser, pos_base_apply, pos_salary):

cur = conn.cursor() #用来获得python执行Mysql命令的方法,操作游标。cur = conn.sursor才是真的执行

insert_data = "INSERT INTO 58yuesao(comp_name,pos_name, pos_base_update,pos_base_browser, pos_base_apply, pos_salary)" "VALUES(%s,%s,%s,%s,%s,%s)"

val = (comp_name,pos_name, pos_base_update,pos_base_browser, pos_base_apply, pos_salary)

cur.execute(insert_data, val)

conn.commit()

conn=pymysql.connect(host="localhost",user="root", password='18030823940',db='58yuesao',port=3306, charset="utf8")

def main():

urls = ['https://cd.58.com/yuesaoyuying/pn{}/?'.format(i) for i in range(1, 8)]

for url in urls:

html = get_one_page(url)

dir = parse_one_page(html)

for href, comp_name in dir.items():

html = get_two_page(href)

comp_name, pos_name, pos_base_update, pos_base_browser, pos_base_apply, pos_salary = parse_two_page(html,comp_name)

save_to_mysql(comp_name, pos_name, pos_base_update, pos_base_browser, pos_base_apply, pos_salary)

if __name__ == '__main__':

main()

《pycharm关联mysql代码》

create database 58yuesao;

use 58yuesao;

create table 58yuesao

(comp_name varchar(40) not null,

pos_name varchar(20) not null,

pos_base_update varchar(15) not null,

pos_base_browser int not null,

pos_base_apply int not null,

pos_salary varchar(20)not null);

ALTER TABLE 58yuesao CONVERT TO CHARACTER SET utf8 COLLATE utf8_unicode_ci

图片来自简书App

图片来自简书App

最后,您可以在数据库中看到您爬取的文件。使用count()可以看到一共爬取了239条数据。

五、我有一个问题要解决

1、同时抓取索引页和详情页的多个内容

2、Ajax 异步加载

3、 抓取被后台屏蔽的信息(eg: pos_base_browser, pos_base_apply)

明天继续解决问题,加油!