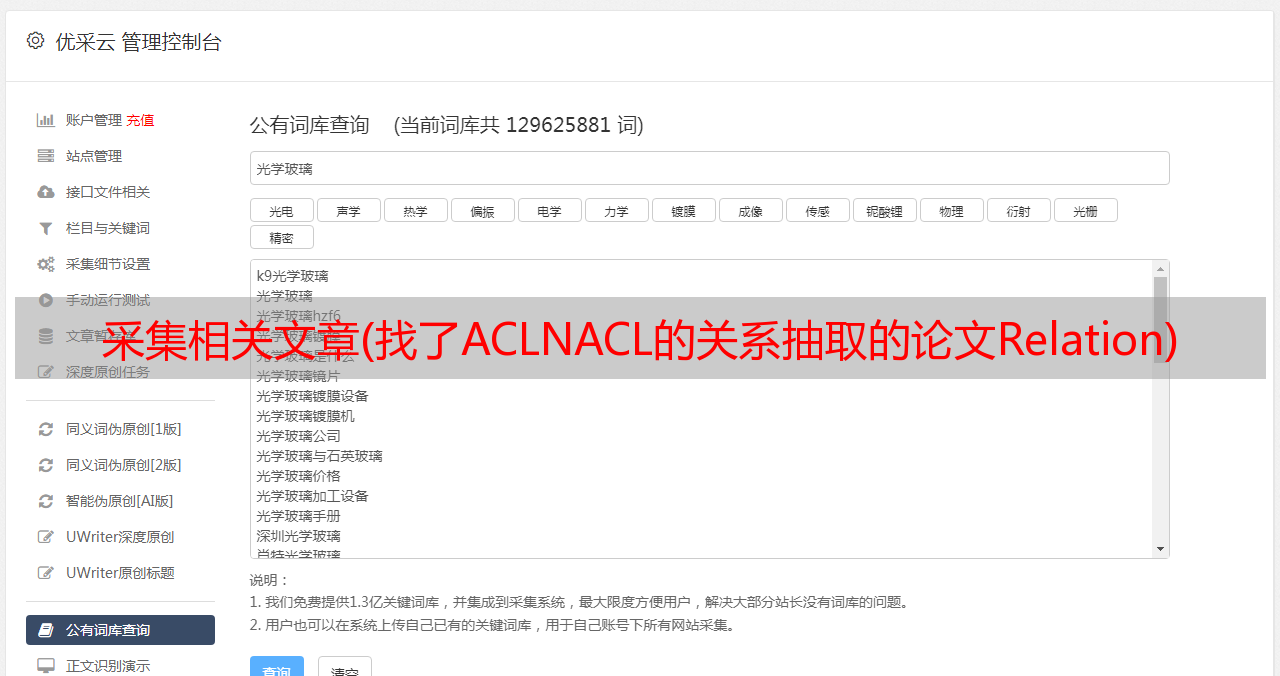

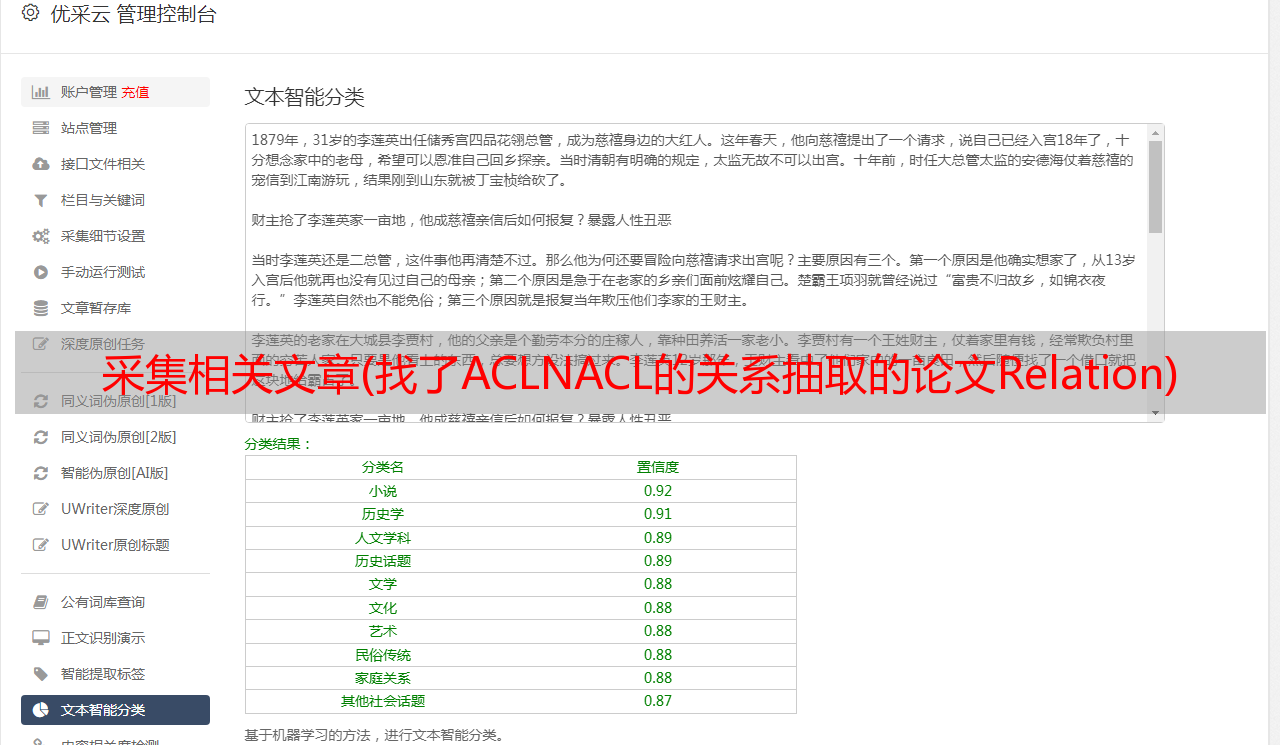

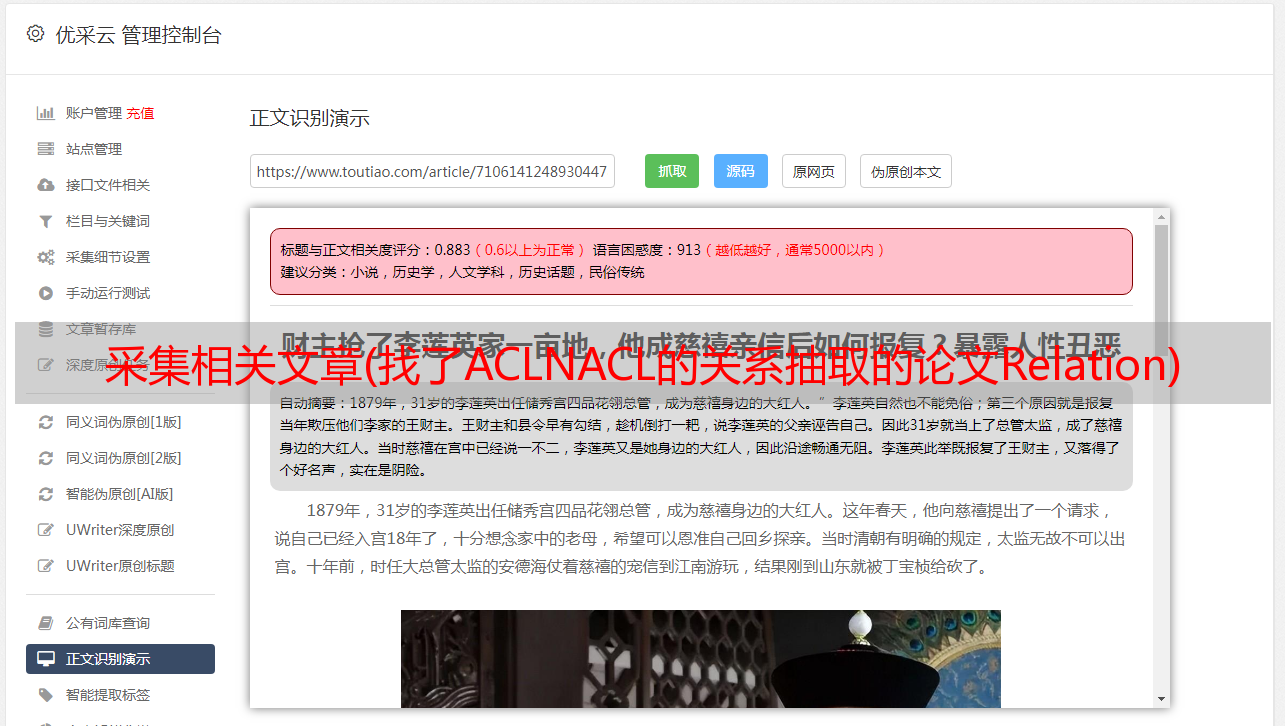

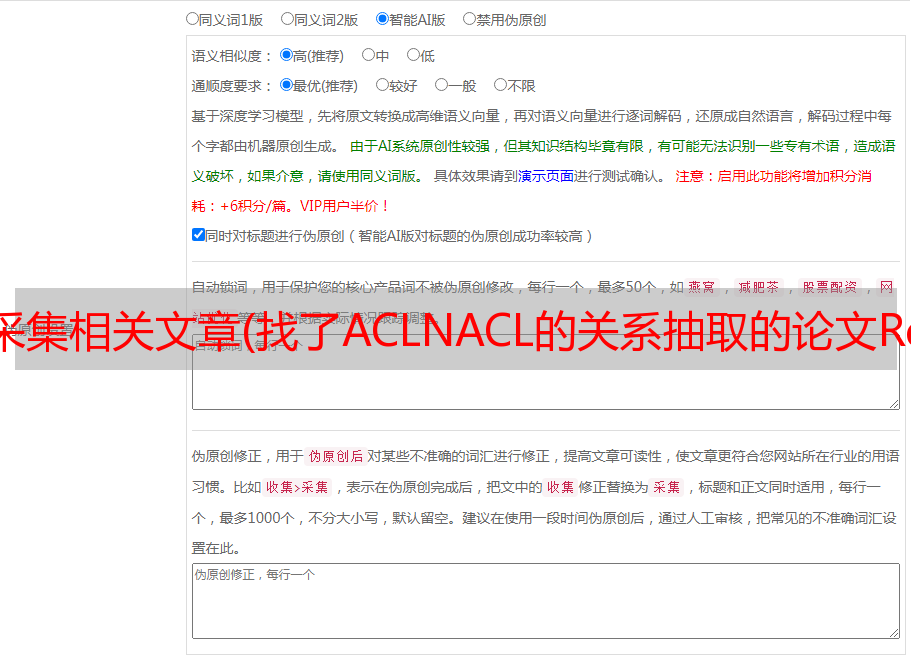

采集相关文章(找了ACLNACL的关系抽取的论文Relation)

优采云 发布时间: 2022-02-22 19:03采集相关文章(找了ACLNACL的关系抽取的论文Relation)

找了近两年ACL NACL EMNLP的一些关系抽取论文

基于实例的选择性注意的神经关系提取(16 年,典型模型)

代码: ()

使用注意机制来最小化错误标签的负面影响;

关系通过使用CNN的句子嵌入的语义组合来表示,从而充分利用训练知识库的信息。

解释参考:

给定一组句子 {x_1...x_n} 和两个对应的实体,我们的模型测量每个关系 r 的概率。在本节中,我们将分两个主要部分介绍我们的模型:

句子编码器:给定一个句子 x 和两个目标实体,卷积神经网络 (RNN) 用于构建句子 x 的分布式表示。

Selective Attention to Instances:在学习所有句子的分布向量表示时,我们使用句子级别的注意力来选择真正表达对应关系的句子。

句子编码器:

图 1 用于句子编码器的 CNN/PCNN 结构

如图 1 所示。句子 x 由 CNN 转换为其分布式表示 X。首先,将句子中的单词转化为密集的实值特征向量。接下来,使用卷积层、最大池化层和非线性变换层来构造句子的分布式表示。接下来,使用卷积层、最大池化层和非线性变换层构建句子的分布式表示。

输入表示:CNN 的输入是句子 x 中的原创单词。我们首先将单词转换为向量。通过词嵌入矩阵将每个输入词转换为向量。此外,为了指定每个实体对的位置,我们还使用句子中所有单词的位置嵌入。

ACL2017

1.用于弱监督关系提取的深度残差学习

模型:9层CNN卷积+深度残差学习(github上源码)

介绍:

关系抽取是一个重要的课题。过去很多论文使用CNN提取特征,但大多只使用了很浅的CNN(大部分只有一层卷积层+1个FC层)。没有人研究过深度 CNN 是否有用。

在本文中,我们研究了用于远程监督的深度 CNN 的 RE(也简称为关系提取)问题。具体来说,本文使用残差学习、词嵌入和位置嵌入作为模型的输入,并使用恒等反馈来研究 RE 问题。实验室使用的是NYT数据集,效果非常好(对比所有CNN模型)。

2.用噪声学习:使用动态转移矩阵增强远程监督关系提取

模型:

1和2和之前的方法一致:对一个句子进行编码,然后分类得到一个句子的分布。同时,3为模型动态生成一个转移矩阵T,用于描述噪声模式。4是将2和3的结果相乘得到最终结果。

也就是说,在训练阶段,将4的输出作为噪声输出和标签匹配,即使用4的输出和训练数据的标签计算训练损失。在泛化阶段,使用2的输出。

简介:使用噪声矩阵来拟合噪声的分布,即对噪声进行建模,从而达到拟合真实分布的目的。

动态转换矩阵可以有效地表征远程监督训练数据中的噪声。利用一种新颖的基于课程的学习方法可以有效地训练转换矩阵,而无需直接监督噪声。

解释参考:

在本文中,作者使用了一种对噪声数据进行显式建模的方法。尽管噪声数据是不可避免的,但可以用统一的框架来描述噪声数据模式。作者的出发点是远程监督数据集中的噪声模式通常有有用的线索。例如,一个人的工作地点和出生地很可能是同一个地方,这种情况下远程监督数据集很可能打错了出生地和工作地这两个关系标签。本文采用的方法是,对于每一个训练样本,都有一个动态生成的转移矩阵。这个矩阵的作用是描述标签错误的概率和指示噪声模式

由于没有对噪声模式的直接监督,作者使用课程学习训练方法逐步训练模型的噪声模式,并使用迹正则化来控制训练过程中转移矩阵的行为。我们的方法是灵活的,因为它不对数据质量做任何假设,但是当存在这样的线索时,可以有效地利用数据质量的先验知识来指导学习过程。

论文的主要创新点:使用动态过渡,使用课程学习来训练模型

3.基于新标记方案的实体和关系联合提取

简介:提出了一种新的序列标记方案,将联合提取问题转换为序列标记问题。此外,将该方案应用于各种端到端模型(使用端到端模型代替命名实体识别、NER和关系提取),并对这些模型的性能进行了比较。本文还提出了一种新模型。

模型:新的标注方案和基于 LSTM 的端到端模型来解决联合提取实体和关系的任务

如图所示,模型的输入是非结构化文本的句子,输出是预定关系类型的三元组。

为了完成这个任务,作者首先提出了一种新的标注模式,将信息抽取任务转化为序列标注任务。如下所示:

这种标注模式将文本中的单词分为两类。第一类表示与提取结果无关的词,用标签“O”表示;第二类表示与提取结果相关的词,该类词的标签由三部分组成:当前词在实体中的位置-关系类型-实体在关系中的作用。作者使用“BIES”(Begin, Inside, End, Single)注解来表示当前词在实体中的位置。关系类型是从一组预设的关系类型中获得的。实体在关系中的角色信息,用“1”、“2”表示。其中,“1”表示当前词属于三元组(Entity1,RelationType,Entity1 of Entity2),“2”表示当前词属于Entity2。最后,根据标注结果,将两对相同关系类型分为两组。相邻的顺序实体组合成一个三元组。例如,从标签中可以看出“United”和“States”组合成实体“United States”,实体“United States”和实体“Trump”组合成三元组{美国,国家总统,特朗普}。如果一个句子收录两个或多个相同关系类型的三元组,我们根据最近原则将两个实体组合成三元组。本文只考虑一个实体只属于一个三元组的情况。两对相同的关系类型被分成两组。相邻的顺序实体组合成一个三元组。例如,从标签中可以看出“United”和“States”组合成实体“United States”,实体“United States”和实体“Trump”组合成三元组{美国,国家总统,特朗普}。如果一个句子收录两个或多个相同关系类型的三元组,我们根据最近原则将两个实体组合成三元组。本文只考虑一个实体只属于一个三元组的情况。两对相同的关系类型被分成两组。相邻的顺序实体组合成一个三元组。例如,从标签中可以看出“United”和“States”组合成实体“United States”,实体“United States”和实体“Trump”组合成三元组{美国,国家总统,特朗普}。如果一个句子收录两个或多个相同关系类型的三元组,我们根据最近原则将两个实体组合成三元组。本文只考虑一个实体只属于一个三元组的情况。合并形成实体“United States”,实体“United States”和实体“Trump”合并形成三元组{United States, Country-President, Trump}。如果一个句子收录两个或多个相同关系类型的三元组,我们根据最近原则将两个实体组合成三元组。本文只考虑一个实体只属于一个三元组的情况。合并形成实体“United States”,实体“United States”和实体“Trump”合并形成三元组{United States, Country-President, Trump}。如果一个句子收录两个或多个相同关系类型的三元组,我们根据最近原则将两个实体组合成三元组。本文只考虑一个实体只属于一个三元组的情况。

端到端模型

当输入是文本句子时,为了自动实现对文本词序列的标注,作者提出了端到端的模型来实现这项工作。模型结构如下

在:

词嵌入层将每个词的one-hot表示向量转换为低维密集词嵌入向量(维度为300);

Bi-LSTM编码层(层数为300)用于获取单词的编码信息;

LSTM解码层(层数为600)用于生成标签序列。添加偏移损失以增强实体标签的相关性。

解释参考:

ACL 2018

4. 通过深度强化学习进行稳健的远程监督关系提取

简介:远程监督的代价是远程监督的训练样本往往有噪声。为了对抗噪音,最近的现有方法侧重于为特定实体对选择最佳句子或计算一组句子的软注意力权重。然而,这些方法都是次优的,误报问题仍然是影响性能的关键瓶颈。我们认为,必须通过硬决策而不是软注意力权重来处理那些错误标记的候选句子。为此,我们探索了一种深度强化学习策略来生成误报指标,其中我们自动识别任何关系类型的误报,而无需任何监督。与之前研究中的删除操作不同,我们将它们重新分配给负例。

我们的深度强化学习框架旨在动态识别误报样本。并在远程监督中将它们从正集转移到负集。

本文研究了使用动态选择策略进行稳健*敏*感*词*的可行性。更具体地说,我们设计了一个深度强化学习代理,其目的是学习根据关系分类器的性能变化来选择是删除还是保留远程监督的候选实例。直观地说,我们的代理希望消除误报并重建一组清洁的远程监督实例,以根据分类准确性最大化重建。该方法与分类器无关,适用于任何现有的*敏*感*词*模型。

提出了一种新的深度强化学习框架,用于鲁棒的远程监督关系提取。

我们的方法与模型无关,这意味着它可以应用于任何最先进的关系提取器。

5.用于关系提取的基于步行的实体图模型

简介:提出了一种新的基于图的神经网络关系提取模型。我们的模型同时处理句子中的多个对,并考虑它们之间的交互。句子中的所有实体都作为节点放置在完全连接的图结构中。边缘由实体对的位置感知上下文表示。为了说明两个实体之间的不同关系路径,我们在每对实体之间构建了 l 长度的游走。生成的游走被合并并不断更新以表示具有较长游走的边缘。在 ACE 2005 数据集上显示出良好的性能,而无需添加其他方法。

这篇文章说,一对实体对之间的关系会受到同一句话中其他关系的影响。比如上图中,Toefting(人实体)通过with直接与队友(人实体)产生关系,而队友通过with和资本(地缘政治实体)直接产生关系。而Toefting和资本可以直接通过队友或间接通过队友建立关系。也就是说,Toefting-teammates-capital的路径有助于Toefting-capital之间的关系。

模型:

解释参考:

6.用于弱监督关系提取的基于排序的自动*敏*感*词*选择和降噪

介绍:

创造性地将关系提取中的自动*敏*感*词*选择和数据去噪任务转化为排序问题;提出了多种策略,既可用于 Bootstrapping 关系提取的自动*敏*感*词*选择,又可用于关系提取和降噪的远程监督;采集自维基百科的 ClueWeb 和 ClueWeb 的数据集,通过实验验证了所提算法的实用性和先进性。

解释参考:

EMNLP2017

7.具有全局优化的端到端神经关系提取

简介:然而,之前使用统计模型的工作表明,全局优化可以实现比局部分类更好的性能。为了更好地学习上下文表示,我们构建了一个全局优化的端到端关系提取神经模型,并提出了新的 LSTM 特征。此外,我们提出了一种新颖的句法信息集成方法来促进全局学习,但需要较少的语法背景并且易于扩展。

解释参考:(我不知道这是什么意思)

8.在神经关系提取中加入关系路径

介绍:提出对文本中的关系路径进行建模,结合CNN模型完成关系抽取任务。

传统的基于CNN的方法通过CNN自动将原文映射到特征空间,并据此判断句子表达的关系

这种 CNN 模型的问题是难以理解多句文本的语义信息。比如A是B的父亲,B是C的父亲,没有办法得到A和C的关系。基于此,论文提出了一种基于神经网络引入关系路径编码器的方法,其实就是原来的词嵌入输入加上一层位置嵌入,位置嵌入分别用两个向量表示当前词与头实体/尾实体的相对路径。然后使用αα平衡文本编码器(E)和路径编码器(G)。

Encoder 还采用了多实例学习机制,使用一个句子集来联合预测关系。句子集的选择方法有随机法(rand)、最大化法(max,选择最有代表性)、选择-注意力机制(att),效果最好。

解释参考:

9.一种软标签的抗噪声远监督关系提取方法

简介:以前的句子级去噪模型由于使用硬标签而未能取得令人满意的性能,这是由训练期间的远程监督和不变性决定的。为此,我们提出了一种实体对级去噪方法,该方法利用正确标记的实体对中的语义信息在训练期间动态纠正错误的标签。我们提出了一个联合评分函数,它结合了基于实体对表示的关系分数和硬标签置信度,以获得特定实体对的新标签,即软标签。在训练过程中,软标签取代硬标签成为金标签。基准数据集上的实验表明,我们的方法显着减少了噪声实例并优于最先进的系统。

对国籍关系进行软标签校正的示例。我们打算使用正确标记的实体对(蓝色)的句法/语义信息来纠正训练中的假阳性和假阴性实例(橙色)。

为了更好地理解我们的知识,我们首先提出了一种实体对级别的抗噪声方法,而之前的工作只关注句子级别的噪声。

我们提出了一种简单而有效的方法,称为软标签方法,用于在训练期间动态纠正错误标签。

EMNLP2018

10. 具有动态路由的基于注意力的胶囊网络用于关系提取

简介:胶囊是一组神经元,其活动向量表示特定类型实体的实例化参数。在本文中,我们探索了在多实例多标签学习框架中用于关系提取的胶囊网络,并提出了一种基于具有注意机制的胶囊网络的新型神经网络方法。

模型:基于注意力的胶囊网络

11.RESIDE:使用边信息改进远程监督神经关系提取(附代码)

简介:我们提出了一种*敏*感*词*的神经关系提取方法,该方法利用 KB 中的附加信息来改进关系提取。它在预测关系时使用实体类型和关系别名信息来施加软约束。Reside 使用图卷积网络 (GCN) 对文本中的句法信息进行编码,并在可用的辅助信息有限时提高性能。

我们提出了一种新的神经网络方法 RESIDE,它利用知识库的额外监督以有原则的方式改进远程监督 RE。

RESIDE 使用图卷积网络 (GCN) 对句法信息进行建模,即使在辅助信息有限的情况下也具有竞争力。

数据集和 RESIDE 源代码:

型号:居住

句法句子编码:Reside 在连接的位置和词嵌入上使用 Bi-GRU 来编码每个标记的本地上下文。为了捕获远程依赖,使用依赖树上的 GCN,并将其编码附加到每个令牌的表示中。最后,注意标记用于抑制不相关的标记并获得整个句子的嵌入。有关详细信息,请参见 5.1 部分。Side Information Acquisition:在这个模块中,我们使用 KBs 的额外监督,并使用开放的 IE 方法来获取相关的 side information。该模型稍后将使用此信息,如 5.2 部分所述。Instance Set Aggregation:在本节中,将句法编码器的句子表示与上一步中获得的匹配关系嵌入连接起来。然后,对句子使用注意力,学习整个包的表示。然后将其与实体类型连接,然后将它们嵌入到 softmax 分类器中进行关系预测。有关详细信息,请参见 5.3 部分。

给定句子的关系别名边信息提取。首先,句法上下文提取器识别目标实体之间的相关关系短语 P。然后它们在嵌入空间中与以 KB 为单位的关系别名 R 的扩展集进行匹配。最后,与最近的别名对应的关系嵌入作为关系别名信息嵌入。

解释参考:

12.使用基于词和实体的注意改进远程监督关系提取