伪原创相似度查询( 【源码目录详解】词库Key的词组及词组(二))

优采云 发布时间: 2022-01-05 07:01伪原创相似度查询(

【源码目录详解】词库Key的词组及词组(二))

详细源码目录

language-ai

|- src/main

| |- java java源码所在目录

| |- com.chenxin

| |- auth 百度AI授权认证模块

| |- base 基础公共抽象模块

| |- config 项目所有自定义配置模块

| |- controller 这个不用多说

| |- exception 全局异常与自定义一次模块

| |- model 项目所有使用的数据模型, dto,vo,bo等

| |- service 业务模块

| |- util 工具模块

| |- auth 授权认证模块

| |- consts 常量类

| |- http http相关

| |- nlp NLP同义词库加载工具

| |- system 系统相关

| |- CommonEnum.java 统一信息处理枚举类

|

| |- AiApplication.java 主启动类

|

|- src/test/java

|- com.chenxin 相关测试代码, 经验证, 若idea版本太低将会导致该单元测试无法使用

其他自行查看源码, 不一一概述

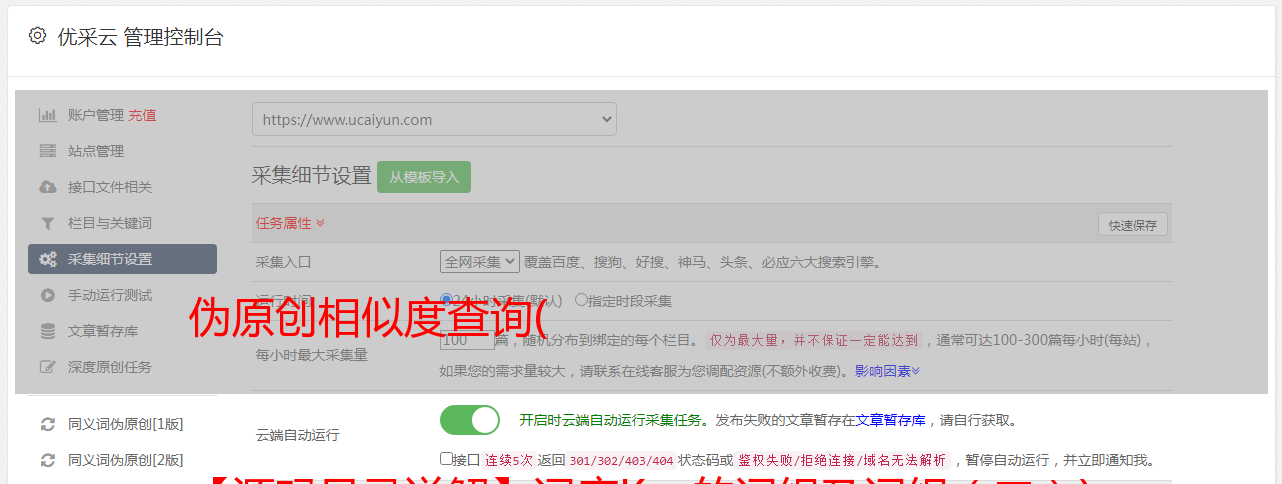

关于词库扩展词库

如果你想要更准确的计算和替换,你需要一个非常准确和庞大的词库,这个词库可以自己慢慢完成

只需将词典添加到文件resource/res/word.txt中,按照格式添加,然后调用初始化redis接口即可。

初始化redis接口/ai/command/initRedis

论词典中单词的重复

这个不用担心,作者在这方面做了很多优化。键值Key相同的词组会全部存储在redis中,以Key0、Key1、

查询时会找出所有具有相同key的词组,并进行去重,然后进行其他操作,计算词义的相似度等等。同样的Key,为了提高

查询效率,默认选择前20组key相同的!

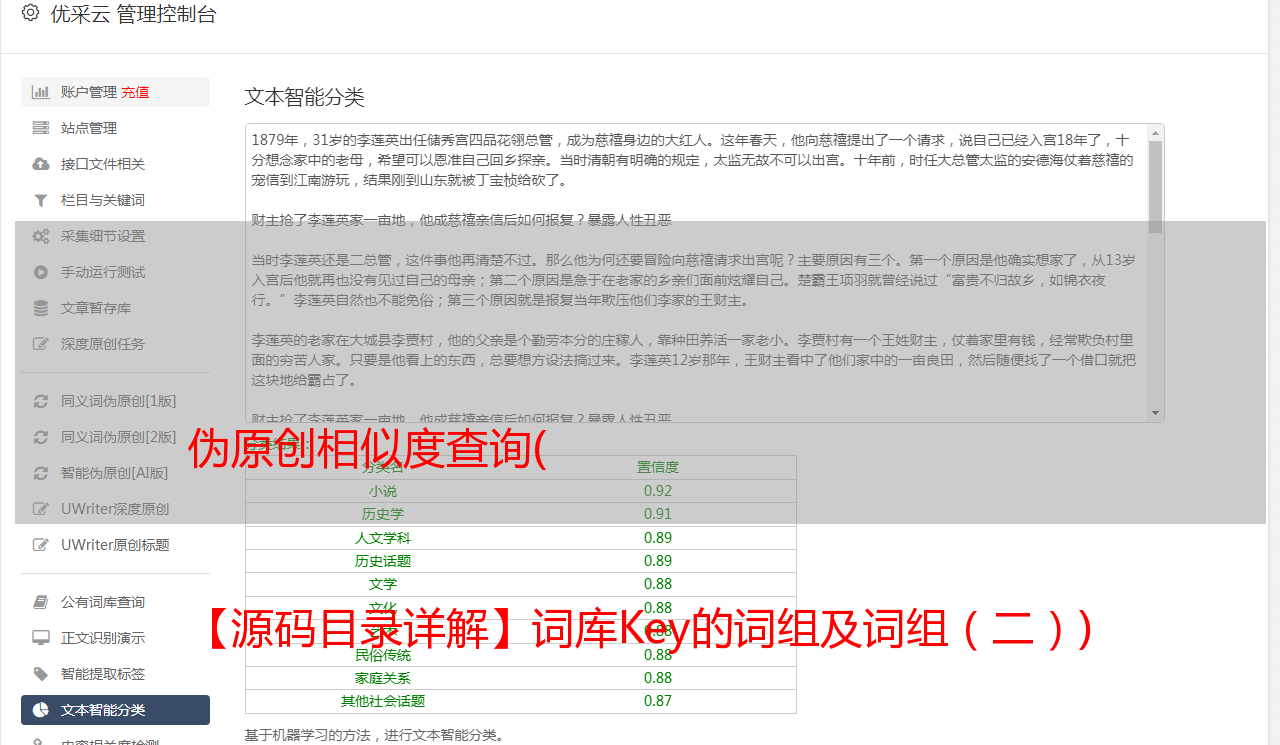

技术图集

本项目整合了多个优秀的NLP项目,共同使用。分词采用百度AI自然语言处理技术的词义分析技术,词义相似度

使用HanLP项目计算同义词的距离!

自然语言处理技术(百度AI提供技术支持) 自然语言处理(hanLP提供技术支持)

HanLP 是由一系列模型和算法组成的 NLP 工具包。目标是普及自然语言处理在生产环境中的应用。

同义词词库技术架构后端前端

本项目的页面只是作为测试使用,以后会构建一个完整的产品网站。

关于作者的问题和优化

热衷于人工智能、分布式微服务、Web应用、大数据等领域。工作室:1024代码工作室,有需要可以联系作者,也可以交流。

邮件:

其他

为什么要使用多个 NLP 项目?原因是我本来想用百度AI来完成整个项目。但由于百度自然语言处理API

对于普通用户来说,有通话次数限制,需要超额收费。因此,相对大量数据的处理将由 HanLP 项目处理。减少数据量

百度的分词将由百度AI处理。